法人がChatGPT Plusを利用するリスク|法人向けプランへの安全な移行策

コピペで即実践!ChatGPT 部門別活用ガイド

営業・総務・法務・IT・経営企画——5つの部門それぞれで、ChatGPTの法人プランをどう使えば効果が出るのか。

活用シーン・実践プロンプト例・カスタムGPTs設計パターンまで収録した、社内展開にそのまま使える実践ガイドです。

こちらのバナーから無料でダウンロードいただけます。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

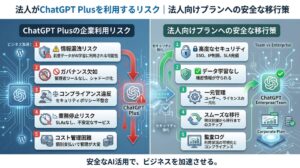

ChatGPT Plusの法人利用はなぜ「推奨されない」のか?セキュリティ上の3つの決定的リスク

ChatGPT Plusは、月額20ドルで最新モデルを利用できる個人向け有料プランですが、ビジネス用途、特に組織的な利用においては「セキュリティの不備」が大きな障壁となります。

多くの企業が利便性から個人アカウントを業務流用していますが、これは組織の存続を揺るがしかねない判断と言わざるを得ません。

入力データが「AIの学習」に利用されるリスクとオプトアウトの限界

OpenAIのデータ処理ポリシーにおいて、ChatGPT Plus(個人向け)は、入力されたデータがデフォルトでAIモデルの改善(学習)に利用される構造となっています。

一度入力された機密情報がAIの学習データに取り込まれると、将来的に他者の回答として出力されるリスクを完全に否定できません。

個人向けプランでは「データの非利用」を契約レベルで完全に保証するものではない点に注意が必要です。

「Temporary Chat(一時チャット)」機能を利用すれば履歴を残さない設定も可能ですが、これはあくまで一時的な機能であり、法人利用における安全性を担保するものではありません。

「シャドーAI」化によるガバナンスの欠如とアカウント管理の不備

企業が公認していない個人アカウントで業務データを処理する「シャドーAI」のリスクも深刻です。

AI利用の統制が取れていない企業において、従業員の40〜60%が非公認ツールを利用しているという調査データもあります。

個人契約のChatGPT Plusを業務で流用する場合、従業員が退職した際に業務データが含まれるアカウントを企業が回収・削除できないといったアカウント管理の欠陥が生じます。

SSO(シングルサインオン)非対応のため、パスワード管理が脆弱になり不正アクセスのリスクが高まります。

GPTs(カスタムGPT)経由の意図しない内部情報流出

ChatGPT Plusユーザーが自作できる「GPTs」機能も、法人利用では大きなリスク要因となります。

特定の業務に特化させるため、ナレッジとしてPDFや社内規定、ソースコードなどの機密ファイルをアップロードした場合、設定の不備によりそれらのファイルが外部からアクセス可能な状態になるリスクが存在します。

コピペで即実践!ChatGPT 部門別活用ガイド

営業・総務・法務・IT・経営企画——5つの部門それぞれで、ChatGPTの法人プランをどう使えば効果が出るのか。

活用シーン・実践プロンプト例・カスタムGPTs設計パターンまで収録した、社内展開にそのまま使える実践ガイドです。

こちらのバナーから無料でダウンロードいただけます。

ChatGPTの法人向けプラン(Team/Enterprise)が担保する安全性の正体【プラン別比較】

ここでは、ビジネスでの安全な利用を実現するために推奨される法人向けプランをご紹介します。

ChatGPT Teamプラン

中小規模のチームに最適なプランで、3名から契約可能です。個人向けプランと同等の機能を持ちながら、管理機能とセキュリティが強化されています。

入力データが学習に利用されないことが保証されているため、社内業務で安心して利用を開始できます。

| 対象 | 3名以上のチーム・中小企業 |

| 学習利用 | なし(保証あり) |

| 管理機能 | Admin Consoleによるユーザー管理 |

| 認証 | SSO(シングルサインオン)対応 |

ChatGPT Enterpriseプラン

大規模組織や、金融・医療などの高度なセキュリティ要件を求める企業向けの最上位プランです。

詳細な監査ログの取得や、外部ツールと連携して会話データを監査できるCompliance APIが提供されるなど、エンタープライズレベルの統制が可能です。

| 対象 | 大企業・高セキュリティ要求組織 |

| 学習利用 | なし(SOC 2/ISO 27001準拠) |

| 管理機能 | 高度なアナリティクス・ドメイン管理 |

| API機能 | Compliance APIによる詳細監査 |

コピペで即実践!ChatGPT 部門別活用ガイド

営業・総務・法務・IT・経営企画——5つの部門それぞれで、ChatGPTの法人プランをどう使えば効果が出るのか。

活用シーン・実践プロンプト例・カスタムGPTs設計パターンまで収録した、社内展開にそのまま使える実践ガイドです。

こちらのバナーから無料でダウンロードいただけます。

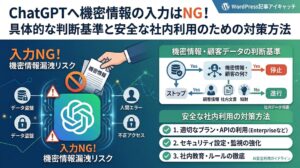

法人利用で直面する主要リスクと実務的な回避策

法人プランを導入しても、ユーザーの運用次第でリスクは発生します。技術的・組織的な対策を組み合わせることが重要です。

情報漏洩リスク:機密情報・個人情報の入力制限とDLPツールの活用

データ学習リスクは回避できても、管理者側のミスによる漏洩リスクはゼロではありません。そもそも機密性の高い情報は入力しないという運用ルールを徹底します。

技術的対策として、DLP(Data Loss Prevention)ツールの活用が有効です。クレジットカード番号等の送信を自動的に遮断できます。

「AIに何を入力してはいけないか」を技術的に制御することが、最も確実な防御策です。

ハルシネーション(幻覚)と権利侵害:出力物の「人間による検証」フロー

AIがもっともらしい嘘をつくハルシネーション(幻覚)や、生成物が他者の著作権を侵害するリスクは依然として残ります。

AIの回答をそのまま外部公開することを禁止し、必ず専門知識を持つ人間が「ファクトチェック」を行うプロセスを業務フローに組み込みましょう。

コピペで即実践!ChatGPT 部門別活用ガイド

営業・総務・法務・IT・経営企画——5つの部門それぞれで、ChatGPTの法人プランをどう使えば効果が出るのか。

活用シーン・実践プロンプト例・カスタムGPTs設計パターンまで収録した、社内展開にそのまま使える実践ガイドです。

こちらのバナーから無料でダウンロードいただけます。

【そのまま使える】AI利用ガイドライン策定テンプレートと禁止事項リスト

実効性のあるガイドラインには、「何を、どこまでやってよいか」を具体的に示す必要があります。

入力禁止情報の定義:個人情報から未公開財務、開発コードまでの段階別整理

情報の機密度に応じて、入力可否をマトリクス化します。顧客・社員の個人情報や独自のソースコードは一律で入力禁止と定めるべきです。

情報の機密度を「極秘・社内・公開」の3段階に分け、入力の可否を明確に定義してください。

利用申請・承認プロセスの設計:部門長と情シスによる二段構えの判定

「誰でも自由に」ではなく、利用目的を明確にするプロセスを設けます。まず部門長が業務上の必要性を承認し、高リスクな利用については情シスや法務が個別に判定を行います。

情シス担当者が構築すべき「AIガバナンス」と運用・監査体制

技術的な管理機能である「Admin Console」を使いこなすことが、ガバナンスの要となります。

Admin Consoleを活用した利用ログの定期的モニタリング手順

法人プランの管理画面では、利用状況の可視化が可能です。月次で「誰が・いつ・どの程度のデータ量を消費したか」を確認します。

深夜や休日の大量利用など、通常とは異なるパターンを早期に発見し、必要に応じて聞き取り調査を行う体制を整えましょう。

従業員向け「AIリテラシー研修」のカリキュラム設計

ツールの導入だけでなく、教育が最大の防御となります。生成AIの仕組みと学習リスクの理解、禁止情報の具体例の周知を徹底します。

「便利な道具」であることを伝えつつ、それ以上に「守るべきルール」を教育することが重要です。

コピペで即実践!ChatGPT 部門別活用ガイド

営業・総務・法務・IT・経営企画——5つの部門それぞれで、ChatGPTの法人プランをどう使えば効果が出るのか。

活用シーン・実践プロンプト例・カスタムGPTs設計パターンまで収録した、社内展開にそのまま使える実践ガイドです。

こちらのバナーから無料でダウンロードいただけます。

国内外の規制動向:個人情報保護法とEU AI法への準拠ポイント

法的なコンプライアンス遵守も、法人利用における重要な責備です。

日本のガイドライン(総務省・経産省・個情委)に基づく法的留意点

日本の個人情報保護法(APPI)では、本人同意なく個人情報をAI学習に利用させることは違法となる可能性が高いです。

顧客データを扱う際は、特に慎重な法務確認が必要であり、経済産業省や総務省の指針に基づいた透明性の確保が求められます。

まとめ:ChatGPT Plusからの移行が企業の信頼性を守る第一歩

ChatGPT Plus(個人向け)の業務流用は、情報漏洩やアカウント管理の不備といった、組織にとって見過ごせないリスクを孕んでいます。

企業の信頼性を守り、AIの恩恵を安全に享受するためには、以下のステップでの対応を推奨します。

1. 法人プラン(Team以上)への速やかな移行:データの学習非利用を契約で担保し、SSOやログ監査の基盤を整える。

2. 実効性のあるガイドラインの策定:入力禁止情報のマトリクス化と、利用申請フローの構築。

3. 継続的なガバナンスと教育:Admin Consoleによる定期監査と、全社的なAIリテラシー研修の実施。

まずは、自社内での現状把握と「シャドーAI」の実態調査から着手しましょう。

コピペで即実践!ChatGPT 部門別活用ガイド

営業・総務・法務・IT・経営企画——5つの部門それぞれで、ChatGPTの法人プランをどう使えば効果が出るのか。

活用シーン・実践プロンプト例・カスタムGPTs設計パターンまで収録した、社内展開にそのまま使える実践ガイドです。

こちらのバナーから無料でダウンロードいただけます。